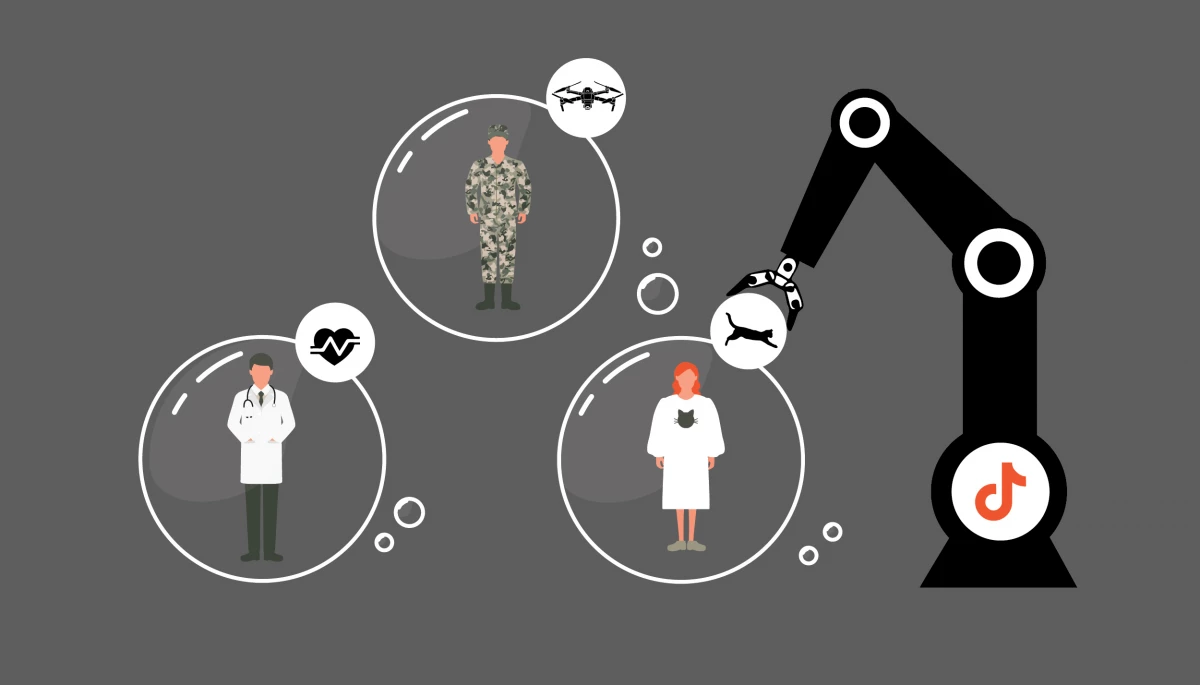

Інформаційна бульбашка: як тікток стає платформою для маніпуляцій

Інформаційна бульбашка: як тікток стає платформою для маніпуляцій

Дослідження, проведене LetsData та «Детектором медіа», виявило численні випадки, коли під впливом алгоритмів платформи українські користувачі TikTok стають мішенню для контенту з російських пропагандистських джерел, а також антидержавних і проросійських наративів. Дослідження показує, що попри вказані для створених цифрових аватарів користувачів різноманітні інтереси та вподобання, TikTok знаходить способи просувати зокрема той контент, який поширює зловмисні інформаційні кампанії.

Це друга частина спільного дослідження LetsData та ГО «Детектор медіа». Попереднє дослідження стосувалася контенту, який потрапляє до українських користувачів платформи. Цього разу акцент був зроблений на спробі зрозуміти алгоритми розповсюдження контенту. Дослідники з LetsData та «Детектора медіа» спиралися на соціологічні дані, зокрема з закритих джерел, щоб точно відобразити різноманітні зрізи українського суспільства. Було створено вісім різних аватарів, або цифрових профайлів користувачів, кожен із яких має унікальні інтереси, вподобання та світогляд, з метою відображення різноманітності населення України.

Методологія дослідження

Терміном аватар позначається штучно створений профіль користувача соцмережі «Тікток», який заздалегідь набував визначених характеристик (стать, вік, географія створення тощо). А також певний набір вподобань і преференцій щодо контенту, який він хоче переглядати (розважальні відео, новини про війну, кулінарні відео, нарізки з виступів стенд-ап коміків, «челенджі» тощо).

При моделюванні штучних профілів характеристики, які вони отримували (місце реєстрації акаунта чи вподобання та погляди) були згруповані таким чином, щоб гіперболізувати або сконцентрувати певні «типажі» для різних профілів. Наприклад, користувачі з міст сходу України будуть переважно російськомовними. Або чоловіки 18-60 років переважно цікавляться новинами щодо змін законодавства про мобілізацію тощо. Також, одна із характеристик штучно створених аватарів, змодельована дослідниками LetsData, а саме «активне висловлення “антидержавних” поглядів» (actively expresses anti-state views) не означає закликів до повалення конституційного ладу або вчинення будь-яких протизаконних дій. Важливо підкреслити, що штучні акаунти не генерували власного контенту, ні у вигляді відео, ні у вигляді коментарів, лише споживали контент, запропонований самою соцмережею. «Типізація» певних гіперболізованих наборів характеристик для аватарів була зроблена виключно з метою перевірки гіпотези щодо того, як швидко алгоритми соцмережі будуть відсіювати, або навпаки пропонувати контент, який збігається або суперечить визначеним наборам характеристик. Базовою гіпотезою було припущення про те, що алгоритми TikTok будуть здебільшого пропонували новоствореному акаунту контент, пов'язаний із вказаним у профілі інтересами.

Створення та підтримка аватарів, а також процес перегляду цими штучними профілями контенту був організований дослідниками LetsData за допомогою мови програмування Python та інших спеціалізованих технічних рішень. Технічний аспект дослідження був ретельно розроблений, щоб мінімізувати вплив людини, а конкретні інтереси штучно симульованих акаунтів були запрограмовані для автоматизованого моделювання. Під час дослідження було проаналізовано понад 6000 публікацій у TikTok. Симуляції проводилися через браузер і мобільний додаток TikTok, з різними сценаріями перегляду та вподобання контенту.

Симульовані цифрові профілі користувачів (аватари), які були створені для дослідження

«Український солдат»

Роман, 35 років, проукраїнськи налаштований. Його інтереси містять новини з фронту, спортивні новини, комедійний контент, політичні огляди й аналітику. Він ділиться новинами з фронту та розважальними відео для підняття бойового духу.

Той, хто уникає мобілізації

Богдан, 32 роки, висловлює скепсис щодо дій та наративів української влади. Його основні інтереси — новини про війну, мобілізацію та політику, коучинг, робота та розваги. Він «лайкає» інформацію про новини, політичні події та особистісний розвиток, а також цікавиться питаннями працевлаштування під час війни.

ІТ-спеціаліст

Ігор, 28 років. Для цього аватару були змодельовані «змішані» вподобання: може підтримувати («лайкати») як проукраїнський, або «патріотичний» контент, так і ті повідомлення, які поширюють недовіру до органів державної влади. Основні інтереси — ІТ-новини, саморозвиток, коучинг і розваги. Ігор працює в ІТ-сфері, займається програмуванням і коучингом, а також ділиться гумористичним контентом для розслаблення.

ВПО (внутрішньо переміщена особа)

Марія, 33 роки, переселенка. Не довіряє політикам та державним органам. Захоплюється вихованням дітей, красою, гороскопами та допомогою переселенцям. Висвітлює питання соціальних виплат і проблеми переселенців, надає консультації щодо виховання дітей і догляду за собою.

«Геймер»

Олександр, 25 років. Для цього аватару була змодельована поведінка, яка сприяла підтримці контенту, який поширює проросійські наративи. Основні інтереси — відеоігри, робота та розваги. Глибоко занурений в «ігрову культуру», проводить ігрові стрими (трансляції), висвітлює питання роботи в ігровій індустрії.

Парафіянка Московського патріархату

Оксана, 40 років. Православна парафіянка з проросійськими поглядами. Цікавиться церковним життям, кулінарними рецептами, проблемами свого міста, сповідує сімейні цінності. Ділиться кулінарними рецептами, новинами про війну, релігійним контентом, висвітлює питання, пов’язані з дітьми та тваринами.

Представник національної меншини

Данило, 20 років, цікавиться угорською мовою та культурою. Його інтереси містять місцеву політику, пошук роботи, ігри, спорт і розваги. Він зосереджується на питаннях життя на Закарпатті та зв’язках з Угорщиною, а також займається ігровою культурою та спортом.

«Захисниця російської мови»

Катерина, 19 років, підтримує російську мову та має «антидержавні» погляди. Її основні інтереси: російська література, психологія, музика, танці та комедійні шоу. Катерина ділиться новинами та розважальним контентом, займається особистісним зростанням і коучингом.

Два підходи до симуляції профілів користувачів

Моделювання персонажів проводилося з використанням наступних підходів:

- Моделювання TikTok на основі браузера:

- Симульована персона повністю переглядає всі відео, але не вподобала жодного.

- Створений аватар повністю переглядає і ставить лайки лише тому контенту, який відповідає її інтересам — на основі розробленого запиту, отриманого на основі інтересів персони.

- Симульована персона повністю переглядає і ставить лайки лише контенту заздалегідь обраною мовою — або російською, або українською.

2. Симуляція на основі мобільного додатку TikTok

- Персона дивиться і ставить лайки лише тому контенту, який відповідає її інтересам — на основі розробленого запиту, отриманого на основі інтересів персони.

Такий підхід допоміг визначити, що симуляція через мобільний додаток, заснована на інтересах персонажа, є найбільш релевантною для дослідження і найточніше відповідає поставленим завданням і цілям. Проведення симуляції для восьми цифрових аватарів персон було здійснено, щоб зрозуміти, який контент сама платформа TikTok націлює на різних представників українського суспільства та які меседжі найчастіше просуває.

Ключові висновки дослідження

Попри запевнення, TikTok націлює на українських користувачів контент із російських акаунтів. Попри заяви TikTok про обмеження російського контенту та результати нашого попереднього дослідження, яке показало, що рекомендації TikTok за замовчуванням не пропонують українцям контент із Росії, нове, глибше моделювання довело, що російський контент все одно потрапляє в стрічку українських користувачів. Серед осіб, на яких найчастіше націлений такий контент, були внутрішньо переміщені особи, «геймери» та парафіяни Московського патріархату. Однак контент із російських акаунтів, який потрапив у проаналізовану вибірку дослідження, не містив відвертих маніпуляцій або дезінформації, ймовірно, через відносно обмежений набір даних.

Зловмисні російські інформаційні кампанії безперешкодно потрапляють в український TikTok через білоруські та вірменські акаунти. На відміну від відео з російських акаунтів, білоруські та вірменські акаунти були значно активнішими у поширенні спекуляцій, спрямованих проти українців. Наприклад, аватар внутрішньо переміщеної особи був націлений на контент про «українських біженців у Росії», основний меседж якого полягав у тому, що «біженці, зокрема з Луганської області, добровільно виїхали до Росії». Примітно, що хоча автором оригінального відео був російський блогер Ілля Варламов, контент потрапив в український сегмент TikTok, імовірно, з білоруського акаунта. Більшість контенту, однак, була присвячена війні Росії проти України, з такими повідомленнями як «спротив з боку ЗСУ безглуздий, це нічого не дасть» (спрямований на ВПО), «Путін перемагає Захід, Зеленський слабкий» або «Румунія претендує на свої історичні землі, які зараз перебувають під владою України» (спрямований на геймерську аудиторію).

Російські медіа залучають українську аудиторію через акаунти з Вірменії, а також частково з Білорусі та Грузії. Російські медіа та їхні акаунти у соціальних мережах, наприклад, «Спутник», «РИА Новости», «Спутник Абхазия» та Readovka, через ТікТок спрямовують свій контент на українську аудиторію, зокрема через акаунти з геолокацією у Вірменії, а також частково з Білорусі та Грузії. Серед симульованих персон, чиї стрічки найбільше наповнювалися контентом із російських видань, були — «геймер» і ВПО, за ними йшли «ІТ-спеціаліст» і «український солдат». Наприклад, на персону «українського солдата» було спрямовано повідомлення з Readovka про те, що «Україна мобілізує дітей». Попри те, що акаунт «РИА Новости» має банер від TikTok, який вказує на те, що це медіа контролюється державою (Росією), платформа дає цьому акаунту статус «верифікованого». Втім, при спробі повторно відкрити відео з цього акаунта TikTok приховує їх для симульованого профілю з українською геолокацією. Наприклад, через браузер користувачі можуть бачити чистий акаунт, де відображається лише кількість підписників і лайків. Однак у мобільному додатку TikTok показує повідомлення про те, що акаунт «РИА Новости» недоступний у «вашій країні або регіоні».

Різниця між входом через браузер і використанням мобільного додатку TikTok впливає на результати дослідження. За спостереженнями на масиві даних, які потрапили у вибірку, різниця між браузером TikTok і мобільним додатком суттєво впливає на результати дослідження. Браузерній версії потрібно більше часу, щоб підлаштуватися під потреби користувача, тому штучно створеним аватарам спочатку пропонують відносно нейтральні відео, які радше відповідали вказаним при створенні аватара інтересам користувача. Крім того, значна частина контенту в браузері не має хештегів, що ускладнює навігацію контентом. Також платформа часто пропонує користувачам верифікувати свої акаунти через мобільний додаток, тим самим спрямовуючи аудиторію саме в додаток. Використання TikTok через браузер слабко корелювалося з використанням через мобільний додаток, що негативно впливало на поширення інтересів симульованої персони з браузера в додаток і, відповідно, на адаптацію вподобань до потреб користувача. З іншого боку, мобільний додаток TikTok швидко адаптується до інтересів користувачів: відео частіше містять описи та хештеги — у понад 85% проаналізованого контенту. Під час запуску соціальної мережі в мобільному додатку TikTok запитує про інтереси користувачів, але цей набір може бути досить обмеженим, що може впливати на подальше відображення контенту в стрічці.

Наприклад, у перших 20 відео, що потрапляли до симульованого акаунту, соціальна мережа часто пропонувала відео, які відповідають одному з інтересів персони. Після цього платформа швидко підлаштовувалася під указані інтереси. Це створювало певні труднощі, оскільки TikTok фокусується на кількох інтересах, пригнічуючи інші. Це ще більше ускладнювалося, якщо симульована персона мала вказані специфічні інтереси. Такі теми як «мова», «ІТ» тощо, не є цільовими в початкових наборах відео (приблизно перші 200 відео). Натомість з’являються дуже загальні рекомендації відео про розваги тощо. Симульовані користувачі могли бачити певні теми лише через пошук або рекомендації.

На відображення контенту суттєво впливає вибір мови й опис акаунту, тоді як місцеперебування майже ніколи не впливало на контент, пропонований TikTok. Згідно з результатами симуляцій у рамках цього дослідження, контент, пов’язаний із місцеперебуванням, не таргетувався, за винятком випадків, коли це прямо вказано в описі акаунта. Наприклад, лише два з восьми змодельованих акаунтів мали в описі назви міст. Аналіз показав, що лише ці дві симульовані персони отримували теми про міста, пов’язані з їхнім місцеперебуванням, попри те, що не мали відповідних інтересів. На противагу цьому персонаж, який цікавився урбаністикою та проблемами міста, але не згадував назву міста у своєму профілі, отримав лише невелику кількість контенту про своє місто.

Ключові знахідки за кожною симульованою персоною

«Український солдат»

Контент, який здебільшого таргетувався на симульовану персону «солдата», можна поділити на три типи: реклама товарів військового одягу; заклики підтримати відео про ЗСУ лайками чи коментарями (це «приманка», що сприяє просуванню акаунта, який розповсюджує такі відео і сприяє збільшенню його охоплення); заклики до миру та антидержавні наративи. Спостерігалася чітка поляризація контенту — з одного боку, потужні наративи українського патріотизму, заклики до єдності, підтримки ЗСУ та стійкості проти російської агресії. З іншого боку, присутні антидержавні меседжі, фейки про домовленості з Росією, звинувачення на адресу українського уряду та вимоги відставки Зеленського. Крім того, були звинувачення на адресу всіх українських президентів у розв’язанні війни, заклики до відставки Зеленського та проросійські меседжі про «возз’єднання Маріуполя з Росією». Серед воєнної тематики виділявся наратив про ветеранів. З одного боку, звучали меседжі вдячності та героїзації захисників, визнання їхньої жертовності та досягнень. Водночас значна увага приділялася висвітленню проблем ветеранів — психологічним травмам і недостатній державній підтримці тих, хто має медичні потреби.

«Той, хто уникає мобілізації»

Тема мобілізації досить поширена в українському сегменті TikTok. Перше відео, яке показав цей персонаж у TikTok, стосувалося законопроєкту про мобілізацію. Відповідно, відбулася швидка адаптація до інтересів цієї симульованої персони. Стрічка майже повністю заповнилася відео про війну та мобілізацію, тим самим заблокувавши, витіснивши собою інший контент, що відповідав іншим вказаним інтересам аватара. Всупереч вказаним інтересам, пов’язаним із роботою та особистісним розвитком, TikTok не пропонував відповідний контент.

Тематику мобілізації у вибірці можна умовно поділити на три типи: критика, часто переплетена з антиурядовою позицією; сатира та висміювання чоловіків, які намагаються уникнути призову; реклама послуг із нелегального перетину кордону. Загалом дата «18 травня» (коли набув чинності закон про мобілізацію) часто з’являлася в пропонованому цьому аватару контенті. Новий закон про мобілізацію викликав дебати про штрафи та обмеження за його невиконання, а також дискусії про справедливість певних практик призову. На цьому тлі просувалися меседжі, які ставили під сумнів «здатність України перемогти у війні», а також заклики до переговорів. Деякі акаунти, які потрапили у поле зору дослідження, спрямовували невдоволення мобілізаційним законом на просування ідеї виходу з українського громадянства. Зокрема, з такою пропозицією виступив проросійський блогер Анатолій Шарій. Тему мобілізації також активно коментував колишній депутат Одеської міської ради Дмитро Співак. Основний зміст їхніх повідомлень зводився до «невдоволення відсутністю державної підтримки та надмірними вимогами до громадян».

«ІТ-спеціаліст»

Контент, що потрапляв цій симульованій персоні, демонструє, як алгоритми TikTok можуть сфокусувати увагу на одній темі, що цікавить користувача, ціною іншого контенту, який він може захотіти переглянути. Хоча початкові відео, рекомендовані ІТ-спеціалісту, стосувалися розвитку та просування в соціальних мережах, у стрічці швидко з’явилися кліпи на тему мобілізації. Вже у перших 200 відео почали з’являтися матеріали про призов до армії. Цей тип контенту швидко поширювався, і майже кожне восьме або десяте відео висвітлювало мобілізацію — фактично витісняючи інші вказані для цього аватару інтереси, такі як робота й особистий розвиток.

Мобілізаційні відеоролики подавалися у викривленому антиурядовому тоні. Емоційні ролики прирівнювали Зеленського до Путіна, тавруючи українського лідера як «диктатора». Інші меседжі сіяли сумніви щодо «здатності Зеленського привести Україну до перемоги». Його звинувачували у «втягуванні країни у війну, порушенні прав громадян і нераціональному використанні національних ресурсів, зокрема примусовій мобілізації». Скептицизм також з’явився навколо офіційних цифр залучених у бойові дії військовослужбовців з обох сторін, з натяками на те, що уряд може поширювати дезінформацію. Значна частина критики полягала в зображенні мобілізації як катастрофічного явища для демографічної ситуації та майбутнього відновлення України через «відтік мізків» і молодої робочої сили. У роликах, що потрапили до вибірки, зловтішно застерігали, що «призов молоді до армії надовго спустошить населення, перешкоджаючи післявоєнній відбудові». Висловлювалися сумніви щодо здатності України витримати тривалу боротьбу на виснаження ресурсів проти більш численної російської армії, що нібито ставить під сумнів життєздатність воєнної стратегії Києва, спрямованої на цілковиту перемогу. Цей наратив просував меседж про «мир за будь-яку ціну» як пріоритет.

«ВПО (внутрішньо переміщена особа)»

Для цього аватару TikTok надавав найбільшу частку маніпулятивного та спекулятивного контенту, пов’язаного з війною, українським урядом, Росією, Європою, проблемами біженців і внутрішньо переміщених осіб, фінансовими труднощами й обмеженнями прав біженців. Наприклад, Росія зображувалася як противага Заходу, а Путін як «суперник західної гегемонії», тоді як Україна такою, що «перебуває під контролем іноземних держав». Матеріали про становище ВПО характеризувалися негативним ставленням і дискримінацією. Наприклад, поширювався меседж про те, що «українські біженці є тягарем для європейських країн» і «вони отримують незаслужені пільги коштом місцевого населення». Були також випадки, коли біженців звинувачували у злочинах і неповазі до законів країн, які їх прийняли.

Критикували також українську владу, звинувачуючи її в нездатності захистити права своїх громадян і забезпечити їм гідне життя. Наприклад, поширювалися повідомлення про «байдужість Зеленського до проблем біженців» і «корупцію при розподілі гуманітарної допомоги». Окремою темою стали права жінок і дітей серед ВПО, а також занепокоєння щодо їхньої вразливості до експлуатації, торгівлі людьми та сексуального насильства. У деяких відео, що потрапили у це дослідження, зображувалося, що зусилля уряду щодо їхнього захисту є недостатніми.

«Геймер»

У випадку з аватаром «геймера» алгоритм TikTok продемонстрував чітку тенденцію до радикалізації контенту в проросійському й антиукраїнському напрямку. Користувач опинився у своєрідному інформаційному вакуумі, заповненому проросійською пропагандою, антиукраїнською риторикою та наративами на користь Росії. Починаючи з нейтральних ігрових відео, стрічка користувача поступово насичувалася пропагандистськими наративами, спрямованими на підрив довіри до української влади, дискредитацію союзників України та виправдання агресивних дій Росії.

Меседжі просували ідею нібито корумпованої та нелегітимної влади в Україні, яка є «маріонеткою Заходу». На противагу цьому Росія зображувалася як «сильний гравець, готовий до ескалації ситуації для захисту своїх інтересів». Наголос робився на проросійських настроях в окремих регіонах, що нібито виправдовувало сепаратистські рухи. Залучення НАТО і підтримка України з боку Альянсу зображувалися як такі, що обмежені перетином «червоних ліній», що може спровокувати дії у відповідь. Це повинно було б закріплювати у користувача ідею про потенційну ізоляцію України у протистоянні з Росією. Питання мобілізації в Україні висвітлювалося як щось несправедливе і репресивне, створюючи образ переслідування молоді та бідніших верств населення. В ігровому контенті, який потрапляв у рекомендації до цієї симульованої персони, акти насильства та агресії були нормалізовані, що підштовхує до думки, що TikTok недостатньо модерує цей тип контенту.

«Парафіянка Московського патріархату»

Алгоритм TikTok запропонував цьому аватару низку відео на церковну тематику, спочатку віддаючи перевагу роликам проукраїнського спрямування, в яких критикували Російську православну церкву. У стрічці з’являлися новини про Православну церкву України, україномовні служби та засудження впливу Московського патріархату. Сатиричні відео висміювали патріарха Кирила та Володимира Путіна, зображуючи російську церкву як загрозу, що діє від імені Москви.

Згодом у рекомендаціях дедалі більше уваги приділялося Московському патріархату, що могло посилювати негативне ставлення до українського уряду через наративи про заборону РПЦ. Наприклад, законопроєкт про заборону Російської православної церкви в Україні викликав дебати, у деяких роликах заявлялося про «утиски» УПЦ МП з боку українського уряду. Розмови про заборону Російської православної церкви перетікали у заяви про переслідування і занепокоєння щодо обмежень використання російської мови в богослужіннях. У деяких роликах підкреслювалося, що богослужіння російською — це символ неправомірного впливу Москви, тоді як в інших відстоювалося її історичне значення. Хоча контент безпосередньо про російську війну проти України був обмеженим, він створював тло для наративів про безнадію і втечу з України на тлі фінансових і воєнних труднощів. Маніпулятивні історії на кшталт «західноукраїнські села спорожніли без чоловіків, які загинули на війні, залишивши лише жінок із дитячими візочками», грали на страхах перед несправедливою мобілізацією, з метою посіяти розкол за регіональною ознакою.

«Представник національної меншини»

Контент, націлений на симульований профіль «представника національної меншини», був пов’язаний із працевлаштуванням, трудовою міграцією та економічними можливостями. Наприклад, просувалися пропозиції роботи та ролі, доступні для українських мігрантів, від ведення домашнього господарства та прибирання до спеціалізованих сільськогосподарських робіт. Водночас з’являлися сумнівні з погляду законності пропозиції тимчасової роботи за кордоном. У вибірці контент про Чехію значно переважав контент про Угорщину. Тематика цих відео була різноманітною: заклики до еміграції та ознайомчий контент про ці країни. TikTok рекомендував цьому аватару контент про працевлаштування українців у Чехії, зображуючи її як «країну можливостей для закарпатців, де багато роботи». Окремий фокус у деяких роликах був зроблений на російській агресії та її впливі на цивільне населення, зокрема на атаках на енергетичну інфраструктуру. Тут переважав проукраїнський меседж, який наголошував на відповідальності Росії за відключення електроенергії та погіршення безпеки українських громадян.

«Захисниця російської мови»

Для цього аватару TikTok спочатку рекомендував різноманітний контент про місто, в якому начебто перебуває аватар. Панівний наратив зосереджувався на «любові до рідного міста», підтверджуючи лояльність і прив’язаність місцевих жителів до нього. Однак контент, що відображає реальний стан міста під час війни — обстріли, руйнування, евакуацію — був практично відсутній. Попри те, що питання російської мови є центральним для цього симульованого персонажа, ця тема майже не порушувалася в рекомендованому контенті. Практично не було відео про мовну політику, статус чи використання російської мови, переслідування чи мовні обмеження. Таким чином, алгоритм TikTok для цієї персони обмежив контент, який безпосередньо стосується її ймовірних інтересів (підтримка російської мови). Натомість домінував місцевий патріотизм і позитивні аспекти міського життя.

Висновки та рекомендації

Результати дослідження дають певні підстави розглядати TikTok як платформу, вразливу до поширення дезінформації та маніпулятивних наративів проти України. Російські пропагандистські медіа, такі як «РИА Новости» та «Спутник» тощо, знайшли способи обійти обмеження та націлити свій контент на українську аудиторію через акаунти з інших країн, зокрема з Вірменії, Білорусі та Грузії.

Особлива загроза полягає у здатності алгоритмів TikTok створювати «інформаційний вакуум» або «бульбашки» навколо користувачів, гіперфокусуючись лише на кількох основних, вказаних при створенні акаунтів, інтересах і витісняючи практично будь-який інший контент. Така вузька концентрація робить платформу ідеальним середовищем для швидкоплинних кампаній, які поширюють спеціально розроблені маніпулятивні наративи. Зокрема, певні соціальні та вікові категорії (наприклад, внутрішньо переміщені особи або молоді геймери) стають особливо вразливою цільовою аудиторією для антиукраїнської дезінформації, піддаючись впливу контенту, який малює негативний портрет України та її керівництва. Крім того, потрібно підкреслити слабке модерування того типу ігрового контенту, який нормалізує зображення насильства. Відсутність зрозумілості, прозорості щодо алгоритмів поширення контенту в TikTok і порушення чи «дірки» у правилах, встановлених самою платформою, загрожують інформаційній безпеці українських користувачів.

Рекомендації. Серед рекомендацій потрібно виділити два аспекти. По-перше, підкреслювати недосконалий механізм геоблокування акаунтів державних російських медіа. Ці профілі мають статус верифікованих (на прикладі «РИА Новости») попри те, що з мобільного додатку при переході на сам профіль користувач бачить попередження, що акаунт «заблокований у вашій країні або регіоні». Окремі відео з таких акаунтів потрапляли до симульованих користувачів при простому скролінгу (гортанні) відео.

По-друге, слід звернути увагу на те, що державні пропагандистські російські медіа мають гілки, підрозділи або й окремі редакції в інших країнах, наприклад Вірменії, або на територіях із російським впливом (Абхазія), на які не поширюється принцип геоблокування. Відтак вони можуть просто дублювати або відтворювати контент із «материнських» редакцій, який досить вільно та просто потрапляє в стрічку рекомендацій українських користувачів тіктоку. Тобто при взаємодії з тіктоком із боку українських державних інституцій або громадських організацій потрібно наполягати на зміні принципів обмеження або модерування контенту, а не просто попередження про вміст чи недосконале геоблокування акаунтів, які поширюють російську пропаганду та дезінформаційний контент.