Нагляд за штучним інтелектом: які норми ЄС має впровадити Україна

Нагляд за штучним інтелектом: які норми ЄС має впровадити Україна

Оригінал публікації на сайті Європейська правда за посиланням

Коли ми говоримо про євроінтеграцію в цифровій сфері, зазвичай згадуємо дані, кібербезпеку або електронні послуги.

Але є ще один "тихий" фактор, який напряму впливає на експорт, інвестиції та здатність українських компаній продавати технології в ЄС. Це правила доступу на ринок.

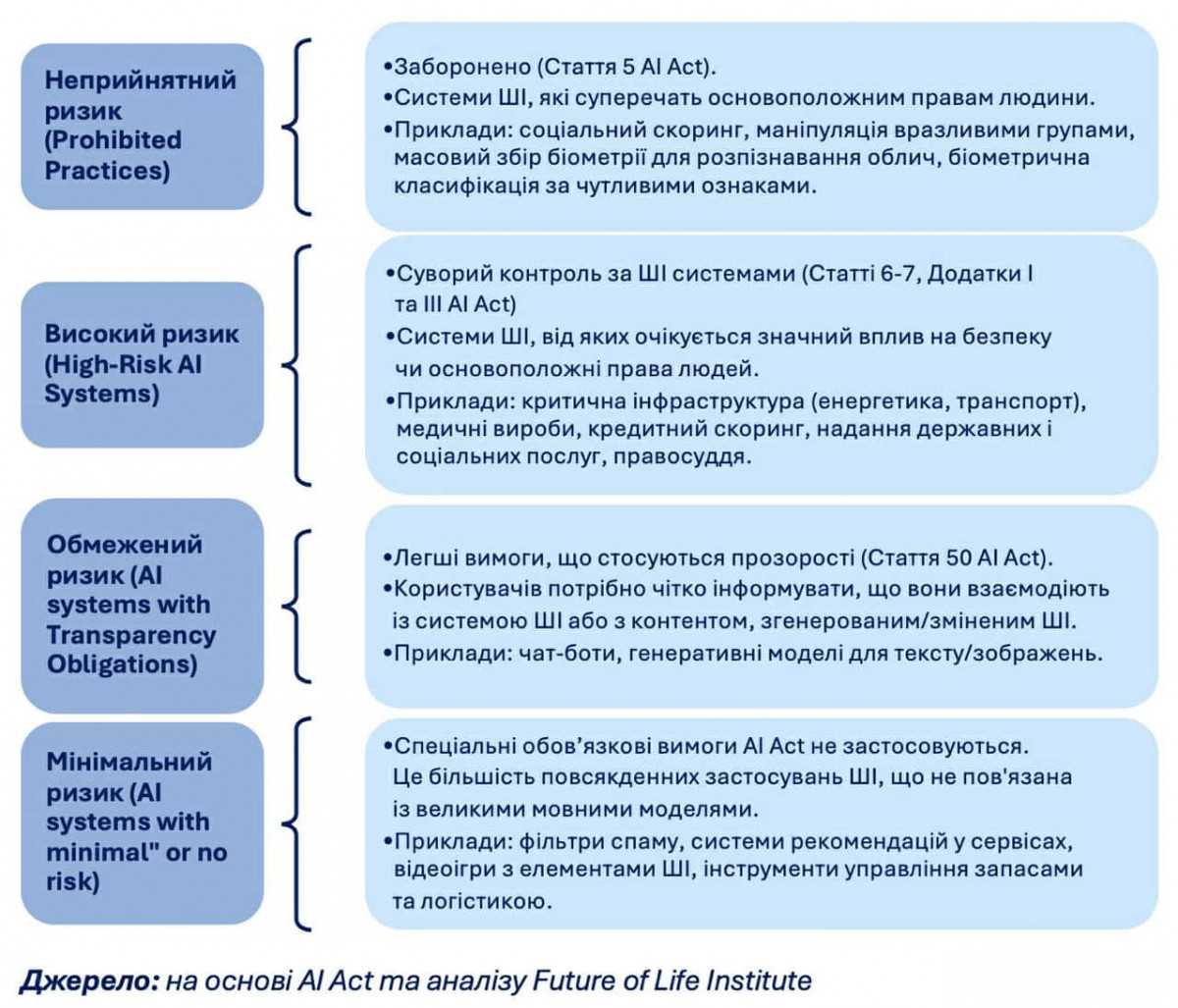

Для продуктів на основі штучного інтелекту такими правилами для експорту послуг в ЄС стає AI Act (Регламент ЄС 2024/1689) із ризикоорієнтованою логікою: що вищий ризик для прав людини та безпеки – то жорсткіші вимоги.

Український ринок ШІ у 2025 році оцінюється в $419,4 млн, в країні є понад 243 ШІ-компанії, а кількість AI/ML-спеціалістів – понад 6100.

Тобто правила ЄС – це про значну частину сектора, який уже зараз живе експортом або планує його.

ЄС сам не встигає

У ЄС під AI Act будується дворівнева інституційна архітектура: є центральний рівень і національні органи, які відповідають за нагляд і правозастосування.

На рівні Єврокомісії створений Офіс ШІ, який виконує роль центрального вузла (реєстр високоризикових систем, приймання звітів про серйозні інциденти, адміністрування кодексів тощо).

А на національному рівні кожна держава має мати щонайменше:

- орган ринкового нагляду (хто перевіряє і застосовує вимоги);

- орган нотифікації (хто акредитує та призначає нотифіковані органи, які вже проводять оцінку відповідності/сертифікацію).

Для України це означає дуже приземлене питання: хто саме буде цими органами і як вони працюватимуть з бізнесом?

Важливий момент: AI Act набирає чинності поетапно. У самому Регламенті прописаний графік. Відповідно до нього минулого року почали діяти заборони для систем із неприйнятним ризиком (із 2 лютого), а також стартували зобов'язання для моделей ШІ загального призначення (GPAI), а держави мали створити національні компетентні органи (із 2 серпня).

Наступний етап – 2 серпня 2026 року, коли вимоги нового закону почнуть повноцінно працювати для більшості високоризикових систем. Також мають запрацювати регуляторні "пісочниці".

І остання дата – 2 серпня 2027 року, коли мають бути виконані всі зобов’язання для окремих категорій "вбудованих" високоризикових систем.

Але є нюанс, який не можна ігнорувати.

ЄС сам зіткнувся з тим, що не встигає розробити технічні стандарти під вже описані регуляції.

Тому у 2025 році Єврокомісія запропонувала (але ще не схвалила) пакет законодавчих ініціатив під назвою "Цифровий омнібус", який фактично визнає: первинний графік був надто оптимістичним.

Зокрема, для систем високого ризику з Додатка III дедлайн пропонується перенести на 2 грудня 2027 (або прив’язати до затвердження стандартів), а для частини інтегрованих систем – на 2 серпня 2028 року.

Це відкриває для України можливість імплементувати AI Act без поспіху, з урахуванням потреб бізнесу.

Скільки це коштуватиме для бізнесу?

Вартість відповідності залежить не стільки від "ШІ як такого", скільки від рівня ризику продукту і ролі компанії (постачальник системи чи користувач/впроваджувач).

Для більшості ШІ-рішень, які не підпадають під критерії високого ризику AI Act, витрати будуть переважно організаційні та юридичні, а не "сертифікаційні":

- підготовка базової документації про призначення системи, обмеження і типові ризики;

- прозорість для користувачів (наприклад, коли людина має знати, що взаємодіє з ШІ, або коли контент є синтетичним);

- внутрішні політики: хто відповідає за якість даних, тестування, реагування на скарги.

Для багатьох компаній це означає не стільки гроші, скільки дисципліну й час.

Для високоризикових систем вимоги жорсткіші. Аналітичний центр Centre for European Policy Studies (CEPS) у 2021 році оцінював обсяги витрат, які мають розробники ШІ в ЄС. Основні статті витрат – процеси, документація, аудит/оцінка відповідності та контроль.

- Система управління якістю (QMS) і технічна документація. Якщо компанія раніше не будувала QMS, старт може бути дорогим: одноразові витрати на побудову процесів, ролей, документації, тестування, управління ризиками – плюс постійні витрати на підтримку. За оцінками CEPS, витрати на створення повністю нової QMS можуть сягати 200–330 тис. євро одноразово, плюс близько 70 тис. євро щорічно на підтримку.

- Оцінка відповідності / сертифікація. Для частини високоризикових систем потрібна зовнішня перевірка. Тут витрати складаються з оплати самої процедури (аудит/нотифікований орган) та внутрішньої підготовки до сертифікації (дані, тестові протоколи, логування, контроль змін, безпека, документація). Вартість сертифікації однієї високоризикової ШІ-системи із залученням європейського нотифікованого органу оцінюється в середньому в 17–23 тис. євро.

- Персонал і перебудова розробки. У високому ризику часто найдорожче – не "сертифікат", а те, що компанія має перейти на більш повільний і контрольований цикл: більше тестів, більше перевірок, більше вимог до даних, формальні процедури релізу і реагування на інциденти. Тут важливий ефект масштабу: малим компаніям важче, бо фіксовані витрати (юристи, комплаєнс, QMS) "з’їдають" більшу частку бюджету.

Якщо припустити, що 10-15% українських ШІ-компаній продукуватимуть високоризиковані ШІ-моделі, загальні витрати бізнесу на виконання всіх вимог AI Act будуть вимірюватися десятками мільйонів євро протягом наступних 3-5 років.

Якщо компанія робить продукт на базі готової великої моделі (використовує моделі Google, OpenAI), і її робота – це переважно інтеграція та створення промптів, без суттєвого донавчання/модифікації моделі, тоді значна частина зобов’язань, пов’язаних саме з розробкою і підтримкою моделі, лежатиме на великому постачальнику моделі.

Розробник фінального продукту більше платить за рівень застосунку: правильне використання моделі, контроль сценаріїв, обмеження, тестування на своєму кейсі, інтерфейсну прозорість, процеси реагування.

Але тут не треба перебільшувати: якщо фінальний продукт сам є високоризиковою системою, то відповідальність за відповідність системи в цілому все одно нікуди не зникає. Просто частина витрат переноситься з розробника продукту до розробника базової моделі.

Але якщо компанія починає активно файнтюнити/переробляти модель, їй доведеться взяти на себе більше зобов’язань.

Що вже зараз має робити Україна?

Для України питання не в тому, чи потрібно наближатися до AI Act, чи ні. Після отримання статусу кандидата на вступ до ЄС і початку переговорного процесу про членство наближення до європейського законодавства стало питанням темпу, а не вибору.

AI Act є частиною acquis communautaire, і його імплементація неминуча.

Українські компанії опинилися в унікальній ситуації: ЄС сам готується відкладати дедлайни, визнаючи складність імплементації. Це дає можливість підготуватися більш виважено, без поспіху та зайвого тиску на бізнес.

Водночас важливо розуміти масштаб викликів.

Найважливіше для України зараз – не впасти в крайнощі. З одного боку, передчасна і надмірно жорстка імплементація може задушити власний ШІ-сектор, який набирає обертів.

З іншого боку, ігнорування європейських стандартів закриє шлях до одного з найбільших технологічних ринків світу.

Приклад самого ЄС показує, що пошук балансу між регулюванням та інноваціями – це процес, а не одноразове рішення. "Цифровий омнібус" засвідчив готовність Європи коригувати курс, коли стає зрозуміло, що початкові амбіції зіткнулися з практичними обмеженнями.

Гармонізація з AI Act для України – це не тільки виконання формальних вимог на шляху до ЄС. Це шанс побудувати довіру до українських технологій на міжнародному рівні, залучити інвестиції в сектор та позиціювати Україну як надійного партнера в розробці штучного інтелекту.