У пошуках безпечного простору: чи покладе DSA край гендерно зумовленому насильству в соцмережах?

У пошуках безпечного простору: чи покладе DSA край гендерно зумовленому насильству в соцмережах?

Великі онлайн-платформи все частіше виявляються втягнутими у скандали, повʼязані з порушенням прав людини. Лише за останні пʼять років можна згадати декілька виразних випадків: внесок соцмереж у розпалювання геноциду в Мʼянмі, невдала модерація мови ворожнечі щодо біженців у Німеччині та Франції, та кілька провальних кампаній щодо закликів до війни в різних контекстах — Сирія, російська агресія в Україні, конфлікт Ізраїлю і ХАМАСу (який навіть спричинив розслідування Європейської Комісію щодо якості модерації X (раніше Twitter).

Ці проблеми виникали на тлі розробки, прийняття і впровадження двох важливих документів, покликаних врегулювати відносини в Інтернеті та зафіксувати обовʼязки платформ у форматі так званого “жорсткого права”: Акту про цифрові послуги (DSA) та Акту про цифрові ринки (DMA). І якщо другий документ є більш технічним і спрямованим на встановлення “правил гри” у фінансовій площині, то перший досить чітко окреслює змістовні і процедурні обовʼязки платформ щодо контенту, його модерації і дизайну сервісів у відповідності правам людини.

Важливо, що крім класичних заборон на поширення пропаганди війни, тероризму чи насилля, а також заборон на мову ворожнечі і контент, шкідливий для дітей, DSA нарешті зробив крок вперед до викорінення гендерно-зумовленого насилля.

Такі активності навіть згадано серед чотирьох категорій контенту, який несе системні ризики на платформах – тобто серед найбільш поширених проблем, що потребують прискіпливої уваги і реакції (цікаво, що в більш ранніх версіях документу таких положень не було). Втім, чи досить самої згадки і чи пропонує регулювання ЄС ефективні механізми подолання проблеми гендерно зумовленого насилля на платформах? Давайте зʼясуємо, що таке DSA і куди рухається європейська практика.

Регулювання платформ: DSA – панацея чи вирок?

DSA став одним з актів в рамках європейської цифрової стратегії — Europe’s Digital Decade, яка покликана створити безпечне онлайн-середовище, гармонізувати регулювання технічних платформ в державах ЄС (на кшталт NetzDG в Німеччині, французьке регулювання проти онлайн-шахрайств та інші національні ініціативи) та запропонувати інноваційні рішення для цифрових викликів. Своєрідним девізом DSA “заборонене в офлайні має бути забороненим і в онлайні”, а 17 лютого 2024 року всі положення цього документу нарешті набрали чинності. Тож про що цей акт?

Хто потрапив у тенета? Дуже великі онлайн компанії (VLOPs) та найбільші пошукові сервіси (VLSE) — ті, які мають більше 45 мільйонів активних користувачів щомісячно — мають додаткові обовʼязки. За загальним правилом до таких компаній належать: месенджери, маркетплейси, інтернет-провайдери, онлайн-платформи, магазини додатків, а також інші онлайн-сервіси, де користувачі можуть обмінюватись повідомленнями, публікувати інформацію чи зберігати її. На сьогодні до списку таких платформ внесли 22 компанії: 19 з них оголосили у квітні 2023 року, а ще 3 компанії, повʼязані з поширенням порнографії, додали у грудні 2023. Інформацію про них можна знайти на окремій сторінці, створеній Європейською комісією. Таким чином, наразі DSA застосовний до:

- маркетплейсів: AliExpress, Amazon, AppStore, Google Play, Google Shopping, Zalando;

- соцмереж: LinkedIn, Facebook, Instagram, Pinterest, Snapchat, Tiktok, X;

- відеоплатформ: Youtube, Pornhub, Stripchat, XVideos;

- пошукових систем: Bing, Google;

- інших сервісів: Google Maps, Booking.com та Wikipedia.

Після оприлюднення списку платформ та перших запитів щодо звітів про виконання вимог DSA декілька компаній вже спробували оскаржити рішення Європейської комісії: серед них Zalando, Amazon (щодо деякого типу зобовʼязань), та X (раніше Twitter). Втім, враховуючи, що всі положення Акту набрали чинності менше, ніж два тижні тому, жодних штрафів чи інших санкцій ще не було накладено Єврокомісією.

Які обовʼязки впроваджує DSA? Серед основних обовʼязків платформ: вимога призначити комплаєнс-офіцера (контактну особу), що слідкуватиме за дотриманням законодавства (в тому числі, і в частині модерування шкідливого і протиправного контенту), регулярне проведення аудитів, а також додаткові вимоги щодо прозорості (як-от, щопіврічний звіт, доступ до кризових протоколів, розкриття інформації про рекламу і алгоритми, і наявність системи рекомендацій, яка не заснована на профілюванні).

Так, в частині прозорості реклами передбачається розкриття відомостей про рекламодавців і подробиць щодо ключових параметрів налаштування реклами (схожа схема застосовна до технічних особливостей систем рекомендацій). Водночас, такі вимоги не покладають на платформ обовʼязків постійного моніторингу – передбачено винятково зобовʼязання належної обачності (від англ. “due diligence”). Зокрема, в межах ЄС підставою видалення контенту все ще є не моніторинг інформації самою платформою, а наявність обґрунтованого повідомлення про порушення. Крім того, Єврокомісія має право видавати додаткові рекомендації-розʼяснення щодо різних аспектів DSA.

Хто стоїть на варті? Якщо коротко – Єврокомісія, Європейська Рада цифрових послуг та спеціально призначені державами (незалежні) координатори. Логічно, що Єврокомісія, в силу завантаженості іншими питаннями, опікується лише ключовими напрямами. Їх всього пʼять:

- вступ у гру, коли ігноруються запити щодо порушень DSA від Координаторів чи Ради;

- коли не комунікується попереднє рішення за місяць до строку завершення спільного розслідування;

- якщо Рада не погоджується з висновками попереднього спільного розслідування;

- якщо проігноровано запит Ради про відкриття спільного розслідування;

- у випадках, коли справа стосується найбільш онлайн-платформ та пошукових систем.

Також Єврокомісія заохочує складати кодекси поведінки та допомагає формувати кризові протоколи, втім ці повноваження є скоріше побічними (а активності можуть виконуватися і без її залучення). Іншим важливим органом є координатори, призначені на національних рівнях, котрі в межах своїх повноважень:

- слідкують за дотриманням платформами зобовʼязань за DSA;

- накладають санкції у випадку порушення DSA;

- призначають юридичного представника в ЄС для платформ, які його не мають;

- створюють та контролюють єдиний контактний пункт з платформами;

- розробляють для користувачів внутрішню систему розгляду скарг на дії платформ.

Важливо, що багато країн вже призначили або якраз перебувають у процесі призначення координаторів цифрових послуг. Деякі з них розподілили повноваження між різними органами, а не призначили чи наділили повноваженнями окремий орган.

Що світить за порушення? Розмір і форма покарання віддана на відкуп національних держав. DSA, втім, встановлює максимальну суму штрафу, яка не може перевищувати 6% світового річного обороту компанії за так звані змістовні порушення DSA і 1% обороту за непроходження перевірки, надання неправдивих відомостей або невжиття належних заходів для виправлення неправильної інформації.

А де ж про гендерно зумовлене насилля? DSA згадує про цю категорію контенту і поведінки двічі – один раз у преамбулі, перелічуючи чотири форми системних ризиків, а інший раз – коли покладає на платформи обовʼязок проводити оцінку ризиків. Так, у статті 34 наголошується, що платформи мають щонайменше раз на рік (а також у випадках критичних збоїв у функціоналі, які впливають на права людини) здійснювати пошук, аналіз та оцінку системних ризиків серед:

- дизайну їхніх систем рекомендацій і будь-яких інших схожих алгоритмічних систем;

- системи модерації контенту;

- умов користування (політик платформ) та їх застосування на практиці;

- системи відбору та подання реклами;

- практик, повʼязаних з даними.

Аналіз має включати лінгвістичні та інші регіональні особливості, а результати таких оцінок платформи повинні зберігати протягом трьох років і надсилати їх відповідним координаторам цифрових сервісів або Європейській Комісії на їх запит.

Гендерно зумовлене насилля онлайн: масштаб катастрофи

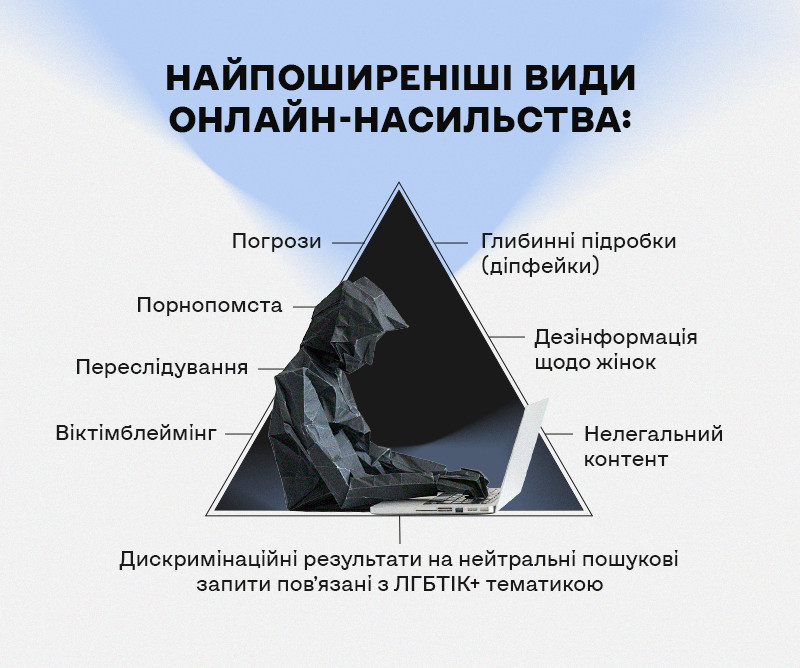

У 2020 році 74% користувачок платформами повідомляли про те, що стикалися з різними формами і проявами онлайн насилля, а у 2018 році 51% користувачок боялися починати публічні онлайн-дискусії через можливі цькування і дискримінацію на підставі статі. Ситуація не надто змінилася у 2024 році, адже кількість способів та технологій для поширення контенту, що може в результаті кваліфікуватися як гендерно зумовлене насилля онлайн тільки зросла. Серед найпоширеніших його форм варто згадати:

- Погрози. Багато жінок стикаються з різними формами онлайн-погроз: починаючи від повідомлень з обіцянками подальшого насилля в реальному житті і завершуючи шантажем для отримання грошей, посади, іншої вигоди внаслідок нерозповсюдження певної інформації онлайн. Платформи, особливо месенджери, дуже неохоче реагують на такі прояви гендерно зумовленого насилля і вживають недостатньо заходів;

- Порнопомста — поширення інтимних зображень колишніми партнерами (або погрози поширити такі фото чи відео) та шантаж на цьому ґрунті. Найчастіше саме жінки стають жертвами такої протиправної поведінки (яка ще й є формою латентної злочинності, адже переважна більшість боїться повідомляти в поліцію через страх поширення оголених фото та відео);

- Переслідування, які можуть відрізнятися залежно від платформи і супроводжуватися погрозами чи шантажем або ж просто створювати психологічний тиск на жінок та призводити до страху користуватися цифровими можливостями;

- Віктімблеймінг (в тому числі повторна віктимізація) — звинувачення постраждалої у випадках, коли йде онлайн-обговорення злочинів (наприклад, злочинів щодо статевої свободи). В таких випадках в коментарях під дописами про зґвалтування і інші злочини часто можна побачити засудження особи, яка наважилася розповісти про пережите насилля. Платформи дуже рідко реагують належним чином, видаляючи контент;

- Глибинні підробки (діпфейки). За допомогою технологій штучного інтелекту створюють зображення та відео жінок з метою подальшого поширення згенерованої порнографії (без їхньої згоди), знущань, дискримінації чи інших форм онлайн-насилля. Наразі без додаткових засобів стає все важче відрізнити справжні візуальні матеріали від штучно згенерованих, а платформи переважно не пропонують додаткових інструментів для подолання цієї проблеми;

- Дезінформація щодо жінок, особливо під час виборчих періодів, де жінки є основними кандидатками у виборчій гонці (зокрема, повідомлення про брак компетенції, досвіду чи здобуття посади неетичними способами), що призводить до репутаційних втрат, проблем з роботою та інших негативних наслідків;

- Нейтральні пошукові запити, повʼязані з ЛГБТІК+ тематикою, часто видають результати, що є дискримінаційними і негативними відносно спільноти (і при цьому знаходяться в топ-пріоритетах платформи за системою рекомендацій);

- Контент, який не є нелегальним, втім все ще здатний спричинити охолоджуючий ефект для участі у суспільній дискусії через страх бути висміяним, приниженим і виключеним з громади чи простору для обговорень;

- Інші форми публічних принижень, дискримінації, погроз та нетичного/протиправного контенту, який в результаті спричиняє негативні наслідки для жінок, представників ЛГБТІК+ та інших захищених груп.

В питаннях оцінок ризиків експерти також зазначають, що гендерно зумовлене насилля часто перебуває поза фокусом уваги, поступаючись питанню “класичної” дискримінації на підставі раси, етнічної приналежності, статі чи релігії. Тож зібрати доказову базу щодо протиправних дій набагато простіше у випадках, коли гендерно зумовлене насилля комбінують з іншими онлайн-порушенням і, навпаки, важче, якщо скаржаться лише на нього. Водночас, особи, які одночасно належать до кількох вразливих груп, ще більше потерпають від онлайн-насилля. Крім того, такий протиправний контент дуже часто потребує контекстуального аналізу — саме тому проблему гендерно зумовленого насилля називають системною (а не ситуативною). Тож ключове питання: чи готовий DSA до таких викликів?

DSA vs гендерно зумовлене насилля: хто виграє?

У своїх оглядах DSA більшість правозахисних організацій згадують про обовʼязок запобігати гендерно зумовленому насиллю на платформах дуже побіжно, не вдаючись у деталі того, як це можна зробити. Наприклад, Amnesty International наголошує, що новели DSA означають, що платформи не зможуть сліпо покладатися на “токсичні алгоритми формування контенту, які посилюють мову ворожнечі, дезінформацію та гендерно зумовлене насилля”, будучи змушеними дизайнувати системи рекомендацій у відповідності з правами людини. Втім, яким саме такий дизайн має бути – організації не уточнюють. Так, Algorithm Watch запропонував методологію, за якою можна проводити оцінку ризиків, але вона містить скоріше набір прикладів, ніж інструмент для регулярних перевірок. CERRE навпаки обрав занадто технічний підхід, який не враховує особливостей кожного з типів небезпечного контенту і є надміру теоретичним. Тож наразі варто чекати на розʼяснення від компетентних органів ЄС.

Що відбувається на практиці з компаніями? Наразі платформи вже надіслали перші звіти щодо прозорості, втім їх формат був дуже хаотичним і жодним чином не уніфікованим. Правозахисні організації підкреслюють, що в майбутньому частиною звітів щодо прозорості має стати і елемент, що стосується гендерних питань (як з технічної точки зору, так і щодо формування та застосування політик). Так, це може включати введення критеріїв вимірювання рівня булінгу, домагань, переслідувань та інших злочинів на підставі гендеру.

Другу частину звітів ще не оприлюднили, але є сподівання, що вони будуть більш детальними і розкриють хоча б частину заходів, які платформи вжили в рамках оцінки ризиків. Для цього, Єврокомісія має прийняти уніфіковані форми звітів про прозорість і створити інформаційну систему взаємодії між трьома гравцями – національними регуляторами, Єврокомісією та Європейською радою цифрових послуг. Наразі обидва документи проходять фінальні стадії обговорення. На щастя, Єврокомісія принаймні спромоглася прийняти керівництво щодо проведення незалежних аудитів для VLOP/SE. Аудит, втім, лише частково покращує ситуацію з недосконалим модеруванням контенту і допомагає вирішити скоріше “косметичні”, аніж глибинні та ціннісні проблеми. Делегований акт, наприклад. жодним чином не розрізняє види контенту і жодного разу не згадує теми гендерно зумовленого насилля. Окремого документа щодо внутрішніх оцінок ризиків експерти і досі очікують із завмиранням подиху, бо він може стати ключовим щодо того, наскільки ефективно взагалі діятиме DSA.

Тож, незважаючи на додаткові вимоги і гарантії, впроваджені на рівні вже прийнятого DSA, все ще залишається досить багато невирішених проблем. Тому, експерти на рівні ЄС активно виступають за прийняття Директиви щодо подолання насилля проти жінок і домашнього насилля, яка була зареєстрована у березні 2022 року. Директива, в тому числі, покриватиме і питання кібербулінгу, порнопомсти та інших дискримінаційних і насильницьких практик, що існують в онлайні. Експерти наголошують, що у разі прийняття Директиви це буде сильним кроком у бік посилення прав жінок, в тому числі через те, що можна буде обійти небажання деяких держав ратифікувати Стамбульську конвенцію. І хоча деякі організації критикували зміст документу через розмиті формулювання і брак чітко визначених причинно-наслідкових звʼязків між бізнес-моделями платформ і гендерно зумовленим насиллям, чергова хвиля закликів узгодити текст Директиви зʼявилася наприкінці січня 2024. І сподіваємося, що цього разу до громадянського суспільства нарешті дослухаються європейські законодавці.

Way to go: DSA набрав чинності, що далі?

DSA набув чинності 17 лютого 2024 року. Чи відбулися кардинальні зміни політик платформ після цієї дати? Практика показує, що скоріше ні. Критичних новел немає, а проблеми тільки зростають з розвитком технологій. Це суттєво непокоїть європейських регуляторів, адже вони не встигають розробити делеговані акти достатньо швидко, щоб запустити супутні процеси і повноцінно покладати відповідальність на платформи. Якщо ж цього не можуть повною мірою зробити на європейському рівні, чи варто Україні влазити в цей процес і грати першу скрипку?

Навряд варто поспішати, але зробити деякі кроки все ж може виявитися корисним як для наших євроінтеграційних процесів, так і для майбутнього регулювання платформ в Україні:

- проаналізувати європейське законодавство та виокремити ті регуляторні ініціативи, які можливо і потрібно починати імплементувати вже зараз (як-от ті, що не потребують прямого і постійного доступу до Єврокомісії чи інших регуляторних органів ЄС);

- збирати докази та відслідковувати практики гендерно зумовленого онлайн-насилля, оформлюючи їх у дослідницькі документи, які згодом можна комунікувати платформам навіть поза інституціями ЄС;

- бути готовими включатися у співпрацю з платформами як довірені партнери (такий формат вже існує в YouTube, Facebook і Twitter, тож громадські організації можуть взаємодіяти з платформами навіть поза регуляторним полем ЄС);

- здійснювати кампанії з медіаграмотності, цифрової грамотності та цифрової безпеки задля попередження найтяжчих форм гендерно зумовленого насильства.

Авторка: Тетяна Авдєєва, медіаюристка

Цей матеріал підготовлено ГО «Жінки в медіа» в рамках проєкту «Мережа ґендерних аналітичних центрів: посилення спроможності задля розробки передових політик, оцінки впливу, стратегічної адвокації та сфокусованих комунікацій щодо політик», що виконується Українським Жіночим Фондом за підтримки Європейського Союзу.